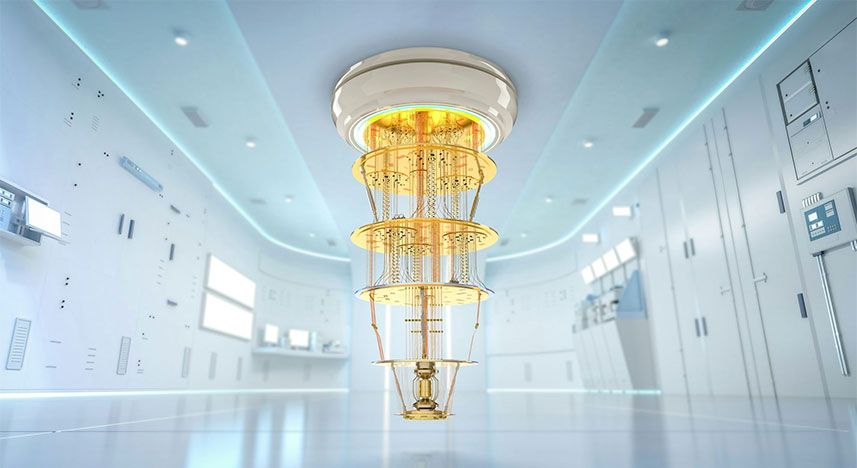

IBM continúa posicionándose como líder en la carrera por la supremacía cuántica, es decir, lograr que un ordenador cuántico resuelva problemas que son imposibles para los ordenadores clásicos. Su ambicioso plan de desarrollar y comercializar el primer ordenador cuántico con 100.000 cúbits tiene el potencial de marcar un hito histórico y redefinir la era de la computación.

El poder detrás de la computación cuántica

La computación cuántica aprovecha fenómenos del mundo subatómico, que resultan tan complejos que a menudo escapan a la comprensión humana. Uno de estos fenómenos es la superposición cuántica, que permite que las partículas estén en múltiples estados simultáneamente. Este comportamiento es clave para los cálculos cuánticos, ya que permite a las computadoras cuánticas procesar información de manera exponencialmente más rápida y eficiente que las computadoras clásicas.

El principio básico de la computación cuántica reside en los cúbits, el equivalente cuántico de los bits en la computación clásica. Mientras que los bits tradicionales solo pueden representar un valor de 0 o 1, un cúbit puede estar en una combinación de ambos valores a la vez, gracias a las propiedades cuánticas. Este cambio de paradigma ha transformado una idea teórica en una realidad palpable en los últimos años.

Del bit al cúbit: una nueva era de eficiencia

El cambio del bit clásico al cúbit cuántico representa un avance sustancial en ciertos problemas computacionales, donde los recursos necesarios aumentan exponencialmente con el tamaño del problema. Un ejemplo ilustrativo es la simulación de un ordenador cuántico de 100 cúbits. Mientras que un ordenador clásico requeriría 2^100 bits (un quintillón de bits) para realizar esta simulación, un ordenador cuántico necesitaría tan solo 100 cúbits. Aunque ya existen máquinas cuánticas con más de 100 cúbits, ninguna de ellas ha alcanzado aún la supremacía cuántica, pero la posibilidad de escalar esta tecnología a miles de cúbits abre nuevas puertas.

IBM, sin embargo, tiene un objetivo aún más ambicioso: desarrollar un ordenador cuántico con 100.000 cúbits. Esta innovación, de lograrse, podría superar las limitaciones actuales y acercarnos más que nunca a la supremacía cuántica.

Superando la era NISQ

Actualmente, la computación cuántica se encuentra en lo que los expertos denominan la era NISQ (Noisy Intermediate-Scale Quantum). Este término, acuñado por el físico John Preskill en 2018, se refiere al estado actual de los ordenadores cuánticos: sistemas con un número limitado de cúbits que aún son propensos a errores debido al ruido cuántico. Este ruido afecta la precisión de los cálculos, limitando la capacidad de las máquinas para realizar tareas que superen las capacidades de los ordenadores clásicos.

La principal barrera para alcanzar la supremacía cuántica es la necesidad de reducir el ruido en los sistemas cuánticos. A pesar de los avances, los cúbits actuales siguen siendo susceptibles a errores que dificultan el procesamiento confiable de información. IBM, sin embargo, ha hecho avances significativos, desarrollando ordenadores cuánticos como IBM Fez (156 cúbits), IBM Torino (133 cúbits) e IBM Kyiv (127 cúbits), que ya se utilizan para resolver problemas complejos en áreas como la optimización y la estructura electrónica, aunque aún sin alcanzar la supremacía cuántica.

Los investigadores de IBM han estado trabajando en métodos para mitigar los errores de los cúbits, lo que implica un mayor tiempo de cómputo pero mejora la precisión de los resultados. Estas mejoras son un indicio de que la ventaja cuántica está cada vez más cerca, ya que los ordenadores cuánticos han comenzado a superar a sus contrapartes clásicas en problemas específicos.

La nueva ola de computación cuántica

IBM ha bautizado su próxima fase de desarrollo como «la siguiente ola», enfocada en la creación de supercomputadoras cuánticas modulares, un enfoque que permitirá escalar esta tecnología de manera más efectiva. La modularidad es clave para esta nueva era de la computación cuántica, ya que permitirá la integración de computación clásica con comunicaciones cuánticas.

Además, IBM está innovando no solo en el hardware, sino también en el software. El middleware cuántico, una plataforma de software híbrida, será fundamental para permitir que los flujos de trabajo clásicos y cuánticos se integren de manera eficiente. Una de las herramientas más prometedoras dentro de este middleware es el «tejido de circuitos cuánticos», que optimiza el uso de puertas cuánticas de dos cúbits para mejorar la eficiencia en la ejecución de circuitos cuánticos.

Para impulsar este proyecto, IBM ha establecido colaboraciones estratégicas con universidades de prestigio como la Universidad de Tokio y la Universidad de Chicago. Estas alianzas están orientadas a resolver los desafíos técnicos y científicos necesarios para alcanzar el siguiente gran hito en la computación cuántica.

Conclusión: El futuro cuántico de IBM

IBM está liderando el desarrollo de la próxima generación de computadoras cuánticas, y su objetivo de alcanzar un sistema de 100.000 cúbits es una prueba de su compromiso con esta visión. Si bien aún estamos en la era NISQ, los avances realizados en la reducción de errores y la creación de arquitecturas modulares sugieren que la supremacía cuántica está cada vez más cerca.

Con un enfoque en la integración de hardware y software cuántico, IBM está sentando las bases para un futuro donde las computadoras cuánticas podrían resolver problemas actualmente inabordables para los sistemas clásicos. Aunque el camino hacia la supremacía cuántica está lleno de desafíos, los pasos que IBM está dando son una señal clara de que estamos al borde de una revolución en la computación.